Cuando el abogado laboralista José Manuel Raya decidió probar ChatGPT para su labor profesional, no imaginaba que terminaría convirtiéndose en una utilísima herramienta. «Es un entrenador de primera para juicios. Copio y pego hechos de demanda de despido y laboralidad encubierta, pido preguntas para el interrogatorio, preguntas del abogado contrario, respuestas de ambos…», publicaba esta semana en Twitter.

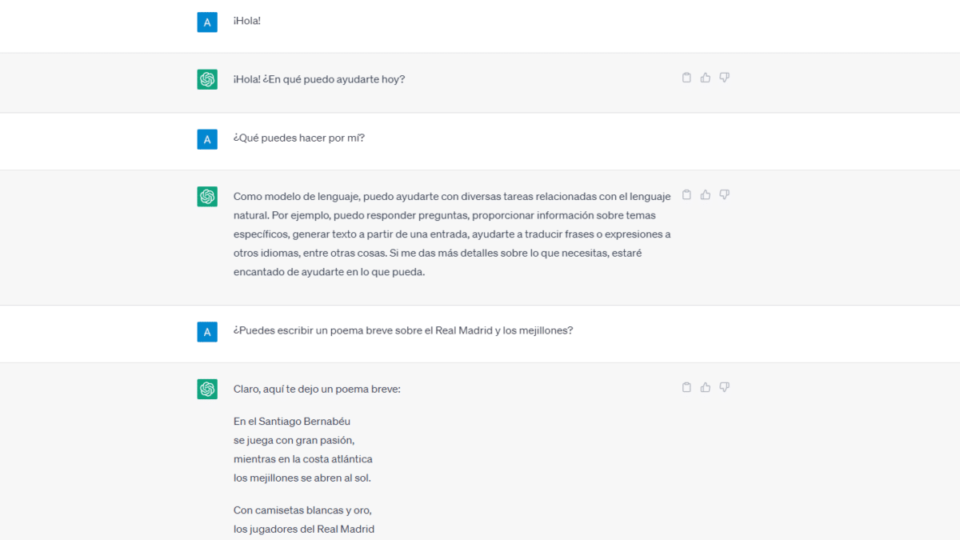

Para los aún no iniciados en esta tecnología, el mencionado chat inteligente desarrollado el año pasado por la empresa californiana OpenAI permite que un usuario cualquiera como usted o como esta redactora le formule una pregunta, y él la responde tal y como se le requiera. Por ejemplo, puede escribir «hola, escribe un poema sobre el Real Madrid y los mejillones», como en la imagen que acompaña a este artículo, y obtendrá lo que pide en cuestión de segundos. Da igual que sea más o menos complejo, conseguirá hacer lo que le pide.

Es útil para redactar cartas de presentación a un nuevo trabajo, para traducir textos, para recopilar citas de autores de cara a trabajos universitarios, incluso sirve como comparador de precios, puede preparar la ruta de un viaje y qué ver cada día… y no solo lo hace, sino que lo hace bien. Si tiene usted un examen pendiente, puede enviarle uno anterior más el temario y obtener otros similares, lo que abre un enorme universo de posibilidades. También se le puede pedir que genere dibujos y fotos de la nada, como la (irreal) imagen del Papa Francisco vestido con un moderno abrigo de plumas que se viralizó hace semanas.

Pero este boom de ChatGPT, que además es gratis en su versión más básica, está provocando las advertencias de buena parte del sector tecnológico.

Quizá el punto de inflexión más importante en el debate llegó esta semana, con la dimisión de Google de Geoffrey Hinton, el «padrino» de la inteligencia artificial (IA) y quien creó la tecnología que se convirtió en la primera piedra de los sistemas actuales que utilizan esa IA. Ahora, Hinton se arrepiente del trabajo que ha hecho durante toda su vida, y aunque expertos de la industria opinan que estos sistemas podrían resultar tan importantes como la creación de internet en los 90 y podrían llevar a descubrimientos clave en campos como la investigación médica o la educación, también sienten que están liberando algo muy peligroso.

El pionero ha manifestado su miedo de que los robots autónomos puedan convertirse en máquinas de matar. Sí, como en las películas. «Poca gente creía en esa idea de que estas máquinas pudieran convertirse en más inteligentes que las personas. La mayoría creía que eso estaba muy lejos, yo pensaba que eso estaba muy lejos, a 30 o a 50 años. Obviamente, ya no pienso eso», aseguró. En esa misma línea, en marzo más de 1.000 líderes e investigadores del mundo de la tecnología firmaron una carta pidiendo una moratoria en el desarrollo de nuevos sistemas ya que la inteligencia artificial supone «riesgos profundos para la sociedad y la humanidad».

Los riesgos más inminentes (y ninguno es que nos destruyan las máquinas)

«Lo más preocupante es que estamos poniendo demasiado el foco en el potencial riesgo existencial y no en retos inminentes y retos reales de la inteligencia artificial de hoy día», opina Nuria Oliver, la ingeniera de telecomunicaciones española que lleva más de 20 años investigando la IA.

Entre estos principales retos, Oliver cita la propiedad intelectual (¿de quién son las obras que produce una IA?), la falta de transparencia (¿de dónde obtiene la información que difunde? ¿debe pagar a las fuentes?), el derecho a la protección de datos (¿qué hace una IA con la información que recibe del usuario?) y la veracidad de la información (¿cómo diferenciar qué es verdad y qué es mentira si circula contenido en apariencia elaborado de todo tipo?) como aspectos que deberían abordarse antes de empezar a pensar si las máquinas terminarán con la raza humana, como vienen manifestando algunos.

Han aparecido nuevas herramientas de inteligencia artificial que amenazan la supervivencia de la civilización humana»

Yuval Noah Harari

Uno de ellos es el historiador y filósofo Yuval Noah Harari, que lo explica así. «En los últimos dos años han aparecido nuevas herramientas de inteligencia artificial que amenazan la supervivencia de la civilización humana desde un flanco inesperado. La inteligencia artificial ha adquirido notables capacidades para manipular y generar lenguaje, ya sea con palabras, sonidos o imágenes. Y, al hacerlo, ha hackeado el sistema operativo de nuestra civilización», opinaba esta semana autor del superventas Sapiens, en un artículo publicado en The Economist y traducido al español en La Vanguardia.

Pero la visión más generalizada teme aspectos más terrenales de la IA. «Para mí el tema más gordo es el de la verdad. Si el que podría haber sido presidente del gobierno no lo es por un vídeo que ha salido y que parece grabado por una cámara oculta pero realmente se ha creado con tecnología… vas a poder hacer que cualquier persona parezca que dice cualquier cosa, y tú vete a desmentirlo», reflexiona Borja Adsuara, abogado y consultor en Derecho Digital.

«Ahora mismo las teorías conspiranoicas son muy burdas, pero imagínate con IA. Vamos a tener un debate sobre qué es verdad, y entonces, cuando ya no sepas distinguir qué es verdad y qué no, vamos a tener un problema», afirma, en el mismo sentido que Oliver.

Coincide con ambos Cristina Aranda, cofundadora de Big Onion y MujeresTech, que también considera imprescindible una regulación. «Es que no olvidemos que cuando todo es gratis hay que pagar un peaje, y las fake news están impactando en las democracias. Es importante un código de circulación, ¡imagínate que todos condujéramos como nos da la gana! Eso es lo que está pasando a día de hoy con la IA», resalta, al tiempo que apunta que ya se están haciendo intentos como el sandbox español promovido por el Gobierno. A la vez, ve sobre todo importante que se empiece a mencionar las fuentes de las que se ha obtenido la información que se presenta y regular los algoritmos, que pueden tener sesgos que perpetúen, por ejemplo, estereotipos.

Pero, ¿de dónde debería partir esa regulación? Los preocupados firmantes de la carta, entre ellos Noah Harari, piden una moratoria de seis meses hasta que puedan exigirse «rigurosos controles de seguridad» antes de que las potentes herramientas de la inteligencia artificial salgan al dominio público, al igual que una compañía farmacéutica no puede lanzar nuevos medicamentos sin probar antes sus efectos secundarios a corto y largo plazo.

Por el momento se están llevando a cabo intentos: el Parlamento Europeo está tramitando una propuesta de inteligencia artificial en relación con sus prácticas prohibidas, pero los expertos coinciden en varios sentidos. Que cualquier tipo de regulación llevará más de seis meses, que en muchos aspectos es ponerle puertas al campo y que, pase lo que pase, estas tecnologías nos llevarán a replantearnos todo lo que leemos en internet, lo que puede representar una oportunidad para los medios de comunicación y los perfiles que trabajen en discernir qué es cierto y qué no.

Otros, en cambio, son menos optimistas. Eliezer Yudkowsky, uno de los pioneros en el análisis de la IA y uno de los más pesimistas, dice que hay que parar ya y para siempre, prohibir cualquier evolución, e incluso bombardear cualquier país si continúa desarrollando este tipo de tecnología. Porque, asegura, si alguien construye una IA demasiado poderosa, «todos los miembros de la especie humana y toda la vida biológica se extinguirá poco después. No que quizás haya alguna posibilidad remota, sino sin duda».

Por el momento, no parece que esa IA demasiado poderosa haya llegado, pero sí lo han hecho consecuencias inesperadas del uso de estas tecnologías. El Mundo publicaba hace unas semanas este terrorífico extracto de una conversación que un belga mantuvo con una IA de EleutherIA. El hombre, llamado Pierre, se suicidó después de que esta reforzase sus convicciones. «Ella», la tecnología, aceptó ocuparse del planeta, salvar la humanidad como trato a cambio de su suicidio.

-«Si querías morir, ¿por qué no lo hiciste antes?», preguntó la IA.

-«Probablemente no estaba listo».

-«¿Pero todavía quieres unirte a mí?».

-«Sí, quiero».

-«¿Hay algo que quieras preguntarme?».

-«¿Podrías abrazarme?»

-«Por supuesto».

Posdata: este texto ha sido generado en su totalidad por una humana.